与 GauGAN 不同的是 , GauGAN2 是在 1000 万张图像上训练而成——可以将自然语言描述转换成风景图 。 GauGAN2 在单个模型中结合了分割映射、修复和文本到图像的生成 。 它不仅可以创建逼真的图像 , 艺术家还可以使用它来描绘超凡脱俗的风景 , 即实际中并不存在的艺术场景 。

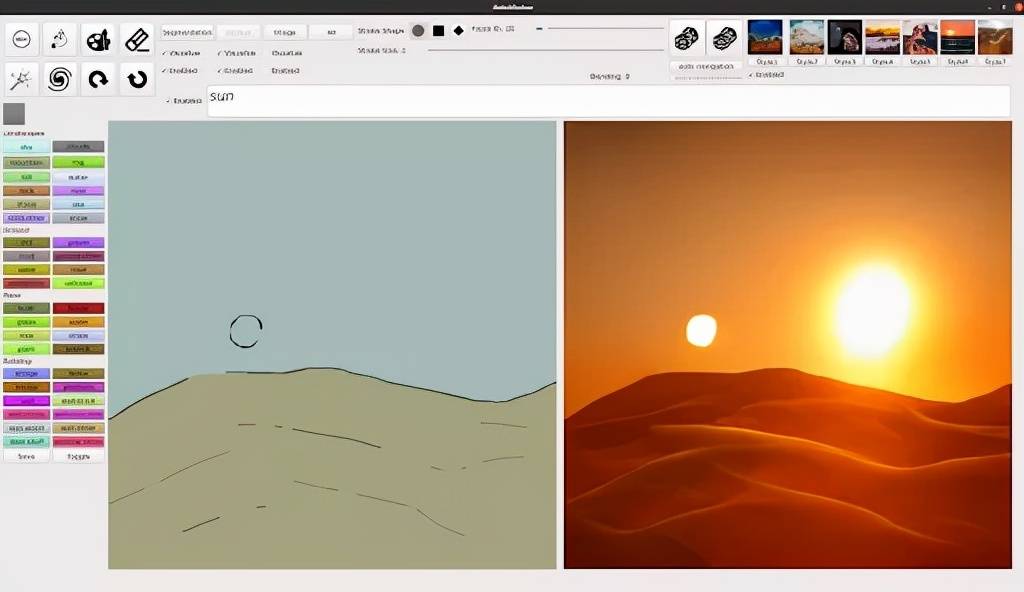

例如星球大战系列中塔图因星有两个太阳 。 借助 GauGAN2 只需输入文本「desert hills sun」来创建一个起点 , 之后用户可在已有一个太阳的情况下快速绘制草图 , 生成想要的效果 。

文章图片

这是一个迭代的过程 , 用户在文本框中键入的每个词都会为 AI 创建的图像添加更多内容 , 因而 GauGAN2 才能随着输入文本而不断变换图像 。

GauGAN2 背后的 AI 模型使用 NVIDIA Selene 超级计算机 , 在 1000 万张高质量风景图像上进行了训练 , 这是一个 NVIDIA DGX SuperPOD 系统 , 是世界上最强大的 10 台超级计算机之一 。 GauGAN2 还借助神经网络来学习词汇与其对应的视觉效果之间的联系 , 例如「冬天」、「有雾」等 。

面向实际应用

GauGAN2 从实用的角度讲是视觉创意生成器 , 在电影、软件、视频游戏、产品、时尚和室内设计中具有潜在应用 。 英伟达声称第一版 GauGAN 已被用于为电影和视频游戏创建概念艺术 。 类似地 , GauGAN2 未来也将提供开源代码并投入应用 。

与 GauGAN2 类似 , 今年年初 OpenAI 发布了号称图像版 GPT-3、120 亿参数的 DALL-E , 后者可以将以自然语言形式表达的大量概念转换为合适的图像 , 效果十分惊艳 。

此类生成模型的一个缺点是可能存在偏见 。 例如在 DALL-E 中 , OpenAI 使用 CLIP 模型来提高生成图像质量 , 但几个月前有研究发现 CLIP 存在种族和性别偏见问题 。

英伟达暂不会对 GauGAN2 是否存在偏见给出回应 。 英伟达发言人表示:「该模型有超过 1 亿个参数 , 训练时间不到一个月(还在 demo 阶段) , 训练图像来自专有的风景图像数据集 。 因此 GauGAN2 只专注于风景 , 研究团队还对图像进行审核以确保图片中没有包含人的场景 。 」这将有助于减少 GauGAN2 的偏见 。

【几个关键词就能出摄影大片,英伟达GauGAN上新2.0:将文本转图像】参考链接:https://blogs.nvidia.com/blog/2021/11/22/gaugan2-ai-art-demo/

特别声明:本站内容均来自网友提供或互联网,仅供参考,请勿用于商业和其他非法用途。如果侵犯了您的权益请与我们联系,我们将在24小时内删除。