关注我们

(本文阅读所需10分钟)

(转自微软亚洲研究院)

此前我们曾提出了一个问题:从文字脚本生成创意视频一共分几步?微软亚洲研究院的开放领域视频生成预训练模型给出了答案:只需一步 。 现在 , 我们追问:除了文字生成视频之外 , 还有哪些途径可以生成视频?我们能否使用自然语言对视觉内容进行编辑?微软亚洲研究院最新推出的多模态模型 NüWA , 不仅让视觉内容创造多了一条路 , 甚至还让 Windows 经典桌面有了更多的打开方式 。

人类对于信息的感知有五种途径 , 包括视觉、听觉、嗅觉、触觉和味觉 , 其中视觉是接受信息的最主要渠道 , 也是创造力的源泉 。 在推动人工智能发展的道路上 , 计算机视觉已经成为一个重要的研究领域 , 尤其是近几年视觉创作类应用的频繁涌现 , 让创作变得越来越便捷 , 越来越多的用户可以用这些工具制作和分享身边的美好生活 。 与此同时 , 视觉类应用的广泛使用也促进了计算机视觉领域的研究 。

然而 , 尽管这些工具功能强大 , 但仍有不足之处:其一 , 它们需要创作者手动收集和处理视觉素材 , 导致现有的大规模视觉数据中所包含的视觉知识无法自动地有效利用 。 其二 , 这些工具往往是通过图形界面与创作者交互 , 并非自然语言指令 , 因此对于一些用户来说 , 具有一定的技术门槛 , 他们需要拥有丰富的使用经验 。 在微软亚洲研究院看来 , 下一代可视化内容创建工具应该能够利用大数据、AI 模型帮助用户更便捷地进行内容创作 , 并使用自然语言作为更加友好的交互界面 。

在这样的理念下 , 微软亚洲研究院在视频生成预训练模型的基础上进行再创新 , 开发了多模态的 NüWA(Neural visUal World creAtion)模型 。 通过自然语言指令 , NüWA 可以实现文本、图像、视频之间的生成、转换和编辑 , 帮助视觉内容创作者降低技术门槛 , 提高创造力 。 同时 , 开发者也可以利用 NüWA 构建基于 AI 的视觉内容创造平台 。

支持八大视觉生成与编辑任务

NüWA 目前支持八大视觉生成和编辑任务 。 其中 , 支持图像的四类任务包括:文本到图像 , 草图到图像 , 图像补全 , 图像编辑;支持视频的四类任务包括:文本到视频 , 视频草图到视频 , 视频预测 , 视频编辑 。

下面 , 让我们以 Windows 经典桌面为例 , 试一下 NüWA 的几个功能 。 (更多 NüWA 在八大任务中的效果 , 请见文末 。 )

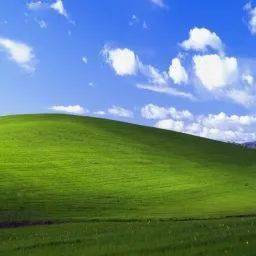

给定一张原始图片:

文章图片

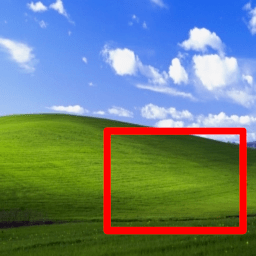

【微软亚洲研究院多模态模型NüWA:以自然语言创造视觉内容】让 NüWA 将图片补全为256x256(图像补全):

文章图片

让 NüWA 在图片的红框位置处添加“一匹在草地上行走的马”(图像编辑):

文章图片

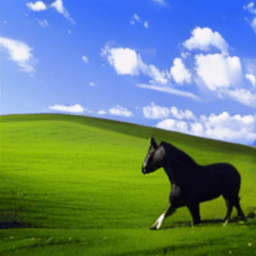

文章图片

让 NüWA 将这张图片生成为一个能“动”起来的视频(视频预测):

文章图片

凭“一己之力”完成多项视觉内容创造任务

NüWA 模型提出了一种全新的 3D 编码器-解码器框架 。 编码器可以支持包括文本、图像、视频 , 或者草图等多种不同的输入条件 , 甚至是部分图片或部分视频 , 让模型补全后续的视频帧;解码器则将这些输入条件转换为离散的视觉标记 , 根据训练数据输出图像、视频内容 。

特别声明:本站内容均来自网友提供或互联网,仅供参考,请勿用于商业和其他非法用途。如果侵犯了您的权益请与我们联系,我们将在24小时内删除。