在大规模数据集和 CNN 架构上的大量实验证明了研究者提出的方法在降低整体计算成本和提升网络准确率方面的有效性 。 例如 , DR-ResNet-50 仅用 3.7G FLOPs 就达到了 77.5% 的 ImageNet top-1 准确率 , 这比计算量多 10% 的 ResNet-50 高出了 1.4% 。

方法

整体架构

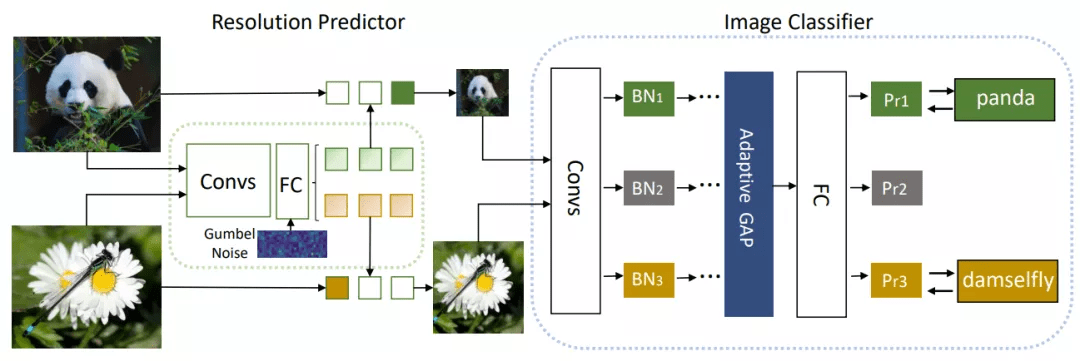

研究者提出了一种实例感知的分辨率选择方法 , 为大型分类器网络选择输入图像的分辨率 。 这种方法包含了两个组件 , 第一个是大型分类器网络 , 例如 ResNet , 它的特点是准确率高和计算成本高 。 第二个是分辨率预测器 , 它的目标是找到一个最小的分辨率 , 这样能为预测每张输入图片来平衡准确率和效率 。

对于任意的输入图片 , 研究者首先用分辨率预测器来预测其合适的分辨率 r 。 然后 , 大型分类器网络将 resized 后的图像作为输入 。 这样 , 当 r 小于原始分辨率时 , FLOPs 就会大幅度减少 。 两种网络在训练时是端到端一起训练的 , 如下图 2 所示 。

文章图片

图 2:模型整体结构图 。

分辨率预测器

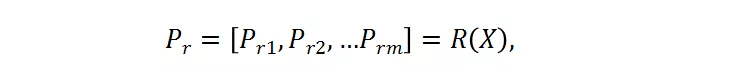

分辨率预测器的设计是基于 CNN 的 。 分辨率预测器的目标是通过得到一个概率分布来找到一个合适的分辨率 。 这里研究者提供 m 个候选分辨率以供分辨率预测器挑选 。 考虑到分辨率预测器会带来额外的计算消耗 , 所以在设计分辨率预测器时只保留了很少的卷积层和全连接层 。

文章图片

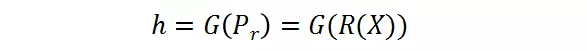

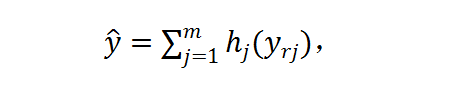

其中 , X 是输入的样本 , 被送入分辨率预测器 。 P_r 是预测器的输出 , 其代表了每个候选的概率 。 候选分辨率中对应的最高概率的那个分辨率将被选为送入大分类器的图片的分辨率 。 这里采用了 Gumbel-Softmax 来实现这种选择过程 , 将其转变成是可微分的:

文章图片

分辨率感知的批正则化(BN)

BN 常用于使得深度模型收敛得更快更稳定 。 然而不同分辨率下的激活统计值 (activation statistics) 包含了均值和方差 , 这使得它们不兼容 。 实验表明 , 使用不同的分辨率下的共享的 BN 会导致更低的准确率 。 考虑到 BN 层只包含了可忽略不计的参数 , 研究者提出分辨率感知的批正则化 , 即对于不同的分辨率 , 使用他们对应的 BN 层 。

训练优化

分类网络与分辨率预测器同时进行训练优化 。 损失函数包含了交叉熵损失函数和研究者提出的 FLOPs 损失函数 。 FLOPs 损失函数用于限制计算量 。

给定一个预训练好的分类网络

文章图片

。 输入 X 并输出概率

文章图片

以用于图像分类 。 对于输入 X , 研究者首先将其 resize 成 m 个候选分辨率 X_r1, X_r2,... , X_rm , 然后使用分辨率预测器对每张图片产生分辨率概率矢量 P_rR^m 。 然后软分辨率概率 P_r 被转变成硬的独热选择 h ?{0,1}^m , 使用 Gumbel-Softmax 。 h 代表了每个样本的分辨率选择 。 在实践中 , 他们首先获得了对于每个分辨率的最终的预测 y_rj=F(X_rj) , 然后将其通过 h 加起来:

文章图片

交叉熵损失函数

文章图片

将在预测 ^y 和标签 y 之间执行:

特别声明:本站内容均来自网友提供或互联网,仅供参考,请勿用于商业和其他非法用途。如果侵犯了您的权益请与我们联系,我们将在24小时内删除。