【pytorch学习资源大全 pytorch 经典教材】机器之心报道

编辑:陈

PyTorch实现各种注意力机制 。

注意力(Attention)机制最早在计算机视觉中应用 , 后来又在 NLP 领域发扬光大 , 该机制将有限的注意力集中在重点信息上 , 从而节省资源 , 快速获得最有效的信息 。

2014 年 , Google DeepMind 发表《Recurrent Models of Visual Attention》 , 使注意力机制流行起来;2015 年 , Bahdanau 等人在论文《Neural Machine Translation by Jointly Learning to Align and Translate》中 , 将注意力机制首次应用在 NLP 领域;2017 年 , Google 机器翻译团队发表的《Attention is All You Need》中 , 完全抛弃了 RNN 和 CNN 等网络结构 , 而仅仅采用注意力机制来进行机器翻译任务 , 并且取得了很好的效果 , 注意力机制也因此成了研究热点 。

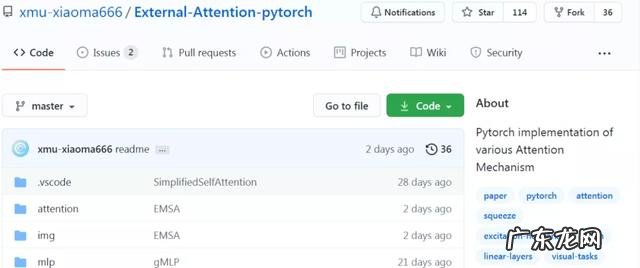

经过几年的发展 , 领域内产生了众多的注意力机制论文研究 , 这些工作在 CV、NLP 领域取得了较好的效果 。近日 , 在 GitHub 上 , 有研究者介绍了 17 篇关于注意力机制论文的 PyTorch 的代码实现以及使用方法 。

文章插图

项目地址:https://github.com/xmu-xiaoma666/External-Attention-pytorch

项目介绍

项目作者对注意力机制进行了分类 , 分为三个系列:Attention 系列、MLP 系列、ReP(Re-Parameter)系列 。其中 Attention 系列中包含有大名鼎鼎的《Attention is All You Need》等 11 篇论文;最近比较热门的 MLP 系列包括谷歌的 MLP-Mixer、gMLP , Facebook 的 ResMLP , 清华的 RepMLP ;此外 , ReP(Re-Parameter)系列包括清华等提出的 RepVGG、 ACNet 。

Attention 系列的 11 篇 Attention 论文 Pytorch 实现方式如下:

文章插图

- Pytorch 实现论文「Beyond Self-attention: External Attention using Two Linear Layers for Visual Tasks—arXiv 2020.05.05」

- Pytorch 实现论文「Attention Is All You Need—NIPS2017」

- Pytorch 实现论文「Simplified Self Attention Usage」

- Pytorch 实现论文 「Squeeze-and-Excitation Networks—CVPR2018」

- Pytorch 实现论文「Selective Kernel Networks—CVPR2019」

- Pytorch 实现论文「CBAM: Convolutional Block Attention Module—ECCV2018」

- Pytorch 实现论文「BAM: Bottleneck Attention Module—BMCV2018」

- Pytorch 实现论文「ECA-Net: Efficient Channel Attention for Deep Convolutional Neural Networks—CVPR2020」

- Pytorch 实现论文「Dual Attention Network for Scene Segmentation—CVPR2019」

- Pytorch 实现论文「EPSANet: An Efficient Pyramid Split Attention Block on Convolutional Neural Network—arXiv 2020.05.30」

- Pytorch 实现论文 「ResT: An Efficient Transformer for Visual Recognition—arXiv 2020.05.28」

- 如何吃下燕麦片泡牛奶这类很难吃的食物? 燕麦片牛奶的吃法大全

- 不节食的减肥方法大全 非节食的快速减肥法

- 水果搭配榨汁食谱大全糖尿病患者吃什么

- 生酮减肥期间食谱大全 生酮减肥食谱搭配

- 草莓的清洗方法大全 草莓正确清洗法

- 关于春分的经典诗词大全

- 二十四节气的谚语 24节气的谚语 大全

- 黄牙美白的简单方法 如何美白的简单方法大全集

- 加韭花的大圪塔豆腐汤 襄垣大块豆腐汤的做法? 油煎豆腐汤的做法大全

- 李小璐出轨照片大全被人奷视频21秒 女生把裤头脱了男生就摸画面不堪入目

特别声明:本站内容均来自网友提供或互联网,仅供参考,请勿用于商业和其他非法用途。如果侵犯了您的权益请与我们联系,我们将在24小时内删除。